52:19

52:19

2025-07-02 10:12

27:23

27:23

27:23

27:23

2024-10-27 10:53

16:13

16:13

16:13

16:13

2022-02-20 07:00

19:09

19:09

19:09

19:09

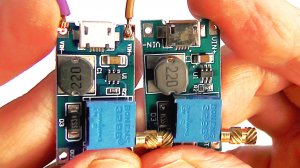

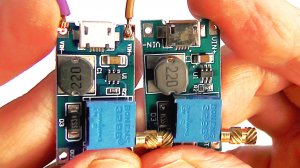

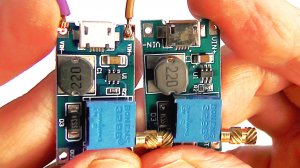

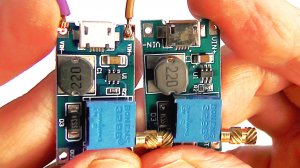

Выход до 100 вольт, ещё интересный вариант доработки MT3608, расчёт КПД и дополнительный эксперимент

2026-04-09 01:05

23:16

23:16

23:16

23:16

2025-12-28 10:50

3:43

3:43

3:43

3:43

2023-11-17 22:11

4:21

4:21

4:21

4:21

2024-08-23 15:09

53:23

53:23

53:23

53:23

2025-03-26 17:41

6:30

6:30

6:30

6:30

2023-09-03 14:44

2:55

2:55

2:55

2:55

2025-05-27 12:33

20:51

20:51

20:51

20:51

2023-05-04 15:07

4:36

4:36

4:36

4:36

2025-02-08 00:46

9:46

9:46

9:46

9:46

2024-01-15 09:41

4:26

4:26

4:26

4:26

2024-01-17 05:00

3:51

3:51

3:51

3:51

2023-11-30 15:01

4:59

4:59

4:59

4:59

2024-12-05 08:06

8:10

8:10

8:10

8:10

2025-08-23 09:17

1:35:42

1:35:42

![Сергей Завьялов - А ты не мучай (Премьера клипа 2026)]() 2:45

2:45

![Сакит Самедов - Королева (Премьера клипа 2026)]() 2:15

2:15

![Игорь Кибирев - Уйду в туман (Премьера клипа 2026)]() 3:50

3:50

![Xhensila – Gjuma (Official Video 2026)]() 2:18

2:18

![Ярослав Леонов - Майская роза (Премьера клипа 2026)]() 3:14

3:14

![Азамат Исенгазин - Ты там, где я (Премьера клипа 2026)]() 3:12

3:12

![Ислам Мальсуйгенов, Зульфия Чотчаева - Заиграла любовь (Премьера клипа 2026)]() 2:15

2:15

![Дана Лахова - Сердечко (Премьера клипа 2026)]() 3:15

3:15

![NITI DILA - Белые лебеди (Премьера клипа 2026)]() 2:30

2:30

![Zarina - Jojji Qaram (Official Video 2026)]() 3:15

3:15

![SHAXO - Паранойя (Премьера клипа 2026)]() 2:22

2:22

![AY YOLA - Aihylyu (Премьера клипа 2026)]() 3:49

3:49

![ARTIX, Анна Калайчева - Под гипнозом (Премьера клипа 2026)]() 2:29

2:29

![StaFFорд63 - Наступит день (Премьера клипа 2026)]() 3:04

3:04

![Альберт Эркенов - Непокорная (Премьера клипа 2026)]() 4:04

4:04

![Дана Лахова - Найдём нашу любовь (Премьера клипа 2026)]() 2:10

2:10

![Шохжахон Жураев - Дилором (Премьера клипа 2026)]() 6:09

6:09

![Винтаж - Малахит (Премьера клипа 2026)]() 3:44

3:44

![KIDA - MENIME (Official Video 2026)]() 2:44

2:44

![Гайратжон Янгибоев & Бонухон - Шахарда (Премьера клипа 2026)]() 3:15

3:15

![Грозовой перевал | Wuthering Heights (2026)]() 2:16:14

2:16:14

![Шары ввех | Balls Up (2026)]() 1:46:45

1:46:45

![Супер Марио: Галактическое кино | The Super Mario Galaxy Movie (2026)]() 1:38:05

1:38:05

![Супер Марио: Галактическое кино | The Super Mario Galaxy Movie (2026)]() 1:38:18

1:38:18

![Йети | The Yeti (2026)]() 1:33:08

1:33:08

![На помощь! | Send Help (2026)]() 1:53:00

1:53:00

![Эта штука работает? | Is This Thing On? (2026)]() 2:00:44

2:00:44

![Zомбилэнд: Контрольный выстрел | Zombieland: Double Tap (2019)]() 1:39:05

1:39:05

![Проект «Конец света» | Project Hail Mary (2026)]() 2:36:26

2:36:26

![Завещание Анны Ли | The Testament of Ann Lee (2025)]() 2:16:48

2:16:48

![Хищный рывок | Thrash (2026)]() 1:26:13

1:26:13

![Обитель зла 3 | Resident Evil: Extinction (2010)]() 1:34:09

1:34:09

![Веном: Последний танец | Venom: The Last Dance (2024)]() 1:48:59

1:48:59

![Я иду искать 2 | Ready or Not 2: Here I Come (2026)]() 1:47:56

1:47:56

![GOAT: Мечтай по-крупному | GOAT (2026)]() 1:39:46

1:39:46

![Острые козырьки: Бессмертный человек | Peaky Blinders: The Immortal Man (2026)]() 1:54:08

1:54:08

![Крик 7 | Scream 7 (2026)]() 1:53:59

1:53:59

![Прыгуны | Hoppers (2026)]() 1:36:21

1:36:21

![Аватар: Пламя и пепел | Avatar: Fire and Ash (2025)]() 3:17:14

3:17:14

![Дьявол носит Prada 2 | The Devil Wears Prada 2 (2026)]() 1:51:51

1:51:51

![Богатырята]() 11:00

11:00

![Полли Покет Сезон 1]() 21:30

21:30

![Чуч-Мяуч]() 7:04

7:04

![Новогодние мультики – Союзмультфильм]() 7:04

7:04

![Лудлвилль]() 7:05

7:05

![Салон дядюшки Брэда]() 1:02

1:02

![Шахерезада. Нерассказанные истории Сезон 1]() 23:53

23:53

![Енотки]() 7:08

7:08

![Тайны Медовой долины]() 7:01

7:01

![Простоквашино. Финансовая грамотность]() 3:27

3:27

![Майло]() 0:25

0:25

![Роботы-пожарные]() 12:31

12:31

![Пингвиненок Пороро]() 7:42

7:42

![Корги по имени Моко. Защитники планеты]() 4:33

4:33

![Папа Супергерой Сезон 1]() 4:28

4:28

![Хвостатые песенки]() 7:00

7:00

![Супер Дино]() 12:41

12:41

![Врумиз. 1 сезон]() 13:10

13:10

![Космический рейнджер Роджер Сезон 1]() 11:32

11:32

![Люк - путешественник во времени]() 1:19:50

1:19:50

![Маша и Медведь. Серия 1. Первая встреча]() 6:36

6:36

![Буба - Все серии]() 3:06:34

3:06:34

![Ми–Ми–Мишки 💫 Звездная история 🙃 Все серии ✨ Мультики для детей]() 2:10:31

2:10:31

![мультфильм «Ну, погоди!» (1-16 серии)]() 2:31:36

2:31:36

![Сборник На Кухне | Уральские Пельмени]() 1:30:27

1:30:27

![Антиреспект - Тишины хочу]() 4:33

4:33

![Сваты 1 сезон (сериал, 2008)]() 2:17:36

2:17:36

![Домовёнок Кузя]() 1:29:32

1:29:32

![Лучшие в Аду (2022)]() 1:49:08

1:49:08

![Сборник Синий Трактор]() 57:36

57:36

![Три Кота | Сборник домашних приключений | Мультфильмы для детей]() 45:14

45:14

![Ми–Ми–Мишки 💫 Звездная история 🙃 Все серии ✨ Мультики для детей]() 2:10:31

2:10:31

![Женщина лёгкого похудения - Уральские Пельмени]() 1:12:19

1:12:19

![Максим ФАДЕЕВ feat. Григорий ЛЕПС - Орлы или вороны ft.и]() 4:38

4:38

![28 лет спустя: Часть II. Храм костей | 28 Years Later: The Bone Temple (2026)]() 1:49:24

1:49:24

![Зверополис | Zootopia (2016)]() 1:48:48

1:48:48

![Аватар 3: Пламя и пепел фильм, 2025]() 3:09:06

3:09:06

![Спартак: Дом Ашура. 1 сезон, 1 серия]() 58:27

58:27

![Бандитский Петербург. Все серии подряд. 60fps]() 66:54:01

66:54:01

![ТОП ЛУЧШИХ КЛИПОВ ШАНСОНА - Слушать шансон лучшее.]() 3:48:45

3:48:45

1:35:42

1:35:42Скачать Видео с Рутуба по ссылке

| 224x144 | ||

| 368x240 | ||

| 552x360 | ||

| 736x480 | ||

| 1112x720 |

2:45

2:45

2026-04-23 11:37

2:15

2:15

2026-04-12 11:24

3:50

3:50

2026-04-21 10:26

2:18

2:18

2026-05-10 12:39

3:14

3:14

2026-05-02 00:31

3:12

3:12

2026-04-29 11:28

2:15

2:15

2026-04-17 12:38

3:15

3:15

2026-04-21 09:41

2:30

2:30

2026-04-28 09:53

3:15

3:15

2026-04-20 17:11

2:22

2:22

2026-04-28 11:11

3:49

3:49

2026-04-20 16:46

2:29

2:29

2026-04-28 10:53

3:04

3:04

2026-04-23 11:16

4:04

4:04

2026-04-10 10:01

2:10

2:10

2026-05-12 12:35

6:09

6:09

2026-04-20 16:56

3:44

3:44

2026-04-28 12:53

2:44

2:44

2026-05-10 12:47

3:15

3:15

2026-04-20 17:02

0/0

2:16:14

2:16:14

2026-04-20 11:54

1:46:45

1:46:45

2026-04-22 00:25

1:38:05

1:38:05

2026-04-12 21:37

1:38:18

1:38:18

2026-05-12 16:55

1:33:08

1:33:08

2026-04-15 12:24

1:53:00

1:53:00

2026-03-27 14:10

2:00:44

2:00:44

2026-05-04 16:12

1:39:05

1:39:05

2026-05-04 12:32

2:36:26

2:36:26

2026-05-12 16:55

2:16:48

2:16:48

2026-03-12 23:31

1:26:13

1:26:13

2026-04-29 20:33

1:34:09

1:34:09

2026-02-25 19:41

1:48:59

1:48:59

2026-05-07 15:08

1:47:56

1:47:56

2026-04-12 17:20

1:39:46

1:39:46

2026-03-27 02:41

1:54:08

1:54:08

2026-03-21 11:57

1:53:59

1:53:59

2026-04-22 11:21

1:36:21

1:36:21

2026-03-27 13:35

3:17:14

3:17:14

2026-04-02 11:34

1:51:51

1:51:51

2026-05-06 10:53

0/0

11:00

11:00

2026-04-23 16:13

2021-09-22 23:09

7:04

7:04

2022-03-29 15:20

7:04

7:04

2023-07-25 00:09

7:05

7:05

2025-12-30 20:49

1:02

1:02

2026-05-07 16:57

2021-09-22 23:25

7:08

7:08

2025-12-30 21:34

7:01

7:01

2022-03-30 17:25

3:27

3:27

2024-12-07 11:00

0:25

0:25

2026-04-10 13:19

2021-09-23 00:12

7:42

7:42

2024-12-17 12:21

4:33

4:33

2024-12-17 16:56

2021-09-22 21:52

7:00

7:00

2025-06-01 11:15

12:41

12:41

2024-11-28 12:54

2021-09-24 16:00

2021-09-22 21:49

1:19:50

1:19:50

2024-12-17 16:00

0/0

2015-02-06 15:18

2024-10-24 16:05

2024-01-17 17:34

2024-12-06 21:59

2025-04-04 18:26

4:33

4:33

2019-12-02 21:15

2:17:36

2:17:36

2025-10-08 08:17

2025-03-15 20:49

2022-10-20 11:01

2024-11-13 13:06

45:14

45:14

2020-04-22 20:10

2024-01-17 17:34

2025-04-18 22:01

4:38

4:38

2017-12-19 08:20

1:49:24

1:49:24

2026-02-19 14:08

1:48:48

1:48:48

2024-12-16 19:01

2025-12-26 16:56

58:27

58:27

2025-12-08 12:06

2023-05-15 17:30

2026-02-02 14:57

0/0